Pendant longtemps, la génération d’images reposait exclusivement sur des descriptions textuelles. On tapait une phrase. On ajustait laborieusement un adjectif. On croisait les doigts en espérant que le modèle de rendu saisisse l’intention. Cette méthode d’itération a ses limites : comment décrire avec une précision mathématique la courbure d’un sourire spécifique ou l’éclairage exact d’une fin de journée d’automne ? Les mots finissent toujours par manquer d’épaisseur face à la complexité visuelle.

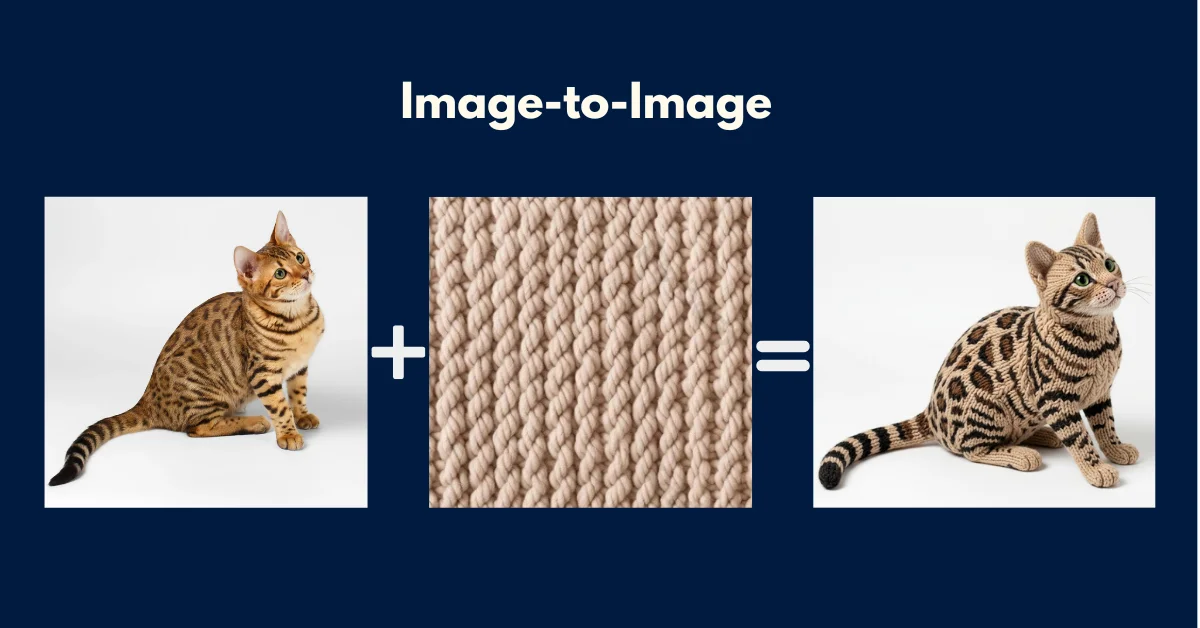

C’est précisément ici qu’intervient l’Image-to-Image (souvent abrégé img2img). L’approche consiste à utiliser une photographie ou un croquis de base, puis d’y injecter un nouveau concept via le texte ou une seconde image. On ne part plus d’une toile blanche. On guide l’algorithme en lui fournissant une fondation architecturale stricte, forçant le système à respecter des contraintes réelles.

L’hybridation de plusieurs références est devenue la compétence technique la plus recherchée par les directeurs artistiques. Qu’il s’agisse de conserver le visage d’un mannequin virtuel d’un décor à l’autre, ou de transposer le style d’un artiste peintre sur une photographie immobilière, la fusion par intelligence artificielle obéit à des règles strictes. Maîtriser la mécanique des poids, l’utilisation des paramètres de référence et la syntaxe multimodale fait toute la différence entre un simple bricolage et une production professionnelle.

Table des matières

- Comment Fusionner Deux Images avec l’IA (La Mécanique Secrète)

- Le Contrôle du Poids (–iw)

- Maîtriser les Références Midjourney (–cref et –sref)

- Formules Multimodales : Mixer Deux Photos par l’Intelligence Artificielle

- 5 Templates de Prompts pour l’Image-to-Image

- Midjourney /blend vs Stable Diffusion IP-Adapter

- Le Raccourci Ultime : L’Outil de Fusion Sémantique

- Foire Aux Questions (FAQ)

Comment Fusionner Deux Images avec l’IA (La Mécanique Secrète)

Photoshop superpose des calques. Il découpe. Il joue sur l’opacité. L’intelligence artificielle, elle, fonctionne d’une manière radicalement différente. Elle ne colle rien du tout. Elle digère l’information sémantique.

Lorsqu’on lui demande de mixer deux éléments, un modèle de vision (comme CLIP, pour Contrastive Language-Image Pre-training) analyse les fichiers sources pour en extraire l’essence. Il isole les concepts fondamentaux de vos photos : un visage anguleux, un éclairage au néon, une texture de cuir usé. Ces éléments sont ensuite traduits en vecteurs mathématiques et envoyés dans ce qu’on appelle l’espace latent. C’est ici, au milieu de ces coordonnées invisibles, que s’opère la véritable fusion. L’algorithme reconstruit alors une image de A à Z en calculant le point d’équilibre entre ces différentes variables.

Le résultat final présente une cohérence physique impossible à obtenir avec un simple montage classique. Si vous fusionnez un portrait pris en plein soleil avec une photo de ruelle sombre éclairée par un lampadaire, la machine recalcule l’incidence de la lumière sur la peau. Les ombres portées se placent correctement. C’est une réinterprétation complète de la scène, tenant compte de la physique simulée de la lumière.

Le Contrôle du Poids (–iw)

Dans la pratique, une fusion à 50/50 donne rarement le rendu espéré. L’un des deux éléments doit presque toujours prendre l’ascendant sur l’autre pour que la composition ait du sens. Sur des plateformes comme Midjourney, la commande --iw (Image Weight) permet de doser cette influence avec une grande précision.

Le paramètre accepte des valeurs spécifiques (allant de 0 à 3 dans les versions récentes). Un poids proche de 0 indique à la machine qu’elle ne doit s’inspirer que très vaguement de la composition originale. Elle en conservera peut-être la palette de couleurs ou l’ambiance globale, mais se sentira libre d’en réinventer les volumes. À l’inverse, une valeur de 2 ou 3 verrouille l’image source. La structure, la pose du sujet et les éléments d’arrière-plan deviennent presque intouchables face aux requêtes textuelles.

Cette asymétrie de contrôle s’avère extrêmement puissante. Imaginez un rapide croquis griffonné sur un bloc-notes. Vous soumettez cette image brute au modèle génératif en poussant le poids au maximum pour préserver les proportions exactes. Ensuite, vous lui demandez par texte de transformer ces lignes au crayon en un bâtiment hyperréaliste en béton et en verre. Le moteur exécute la commande de rendu tout en respectant votre architecture initiale au millimètre près.

Maîtriser les Références Midjourney (–cref et –sref)

L’une des plus grandes frustrations des designers a longtemps été la perte de l’identité visuelle d’une génération à l’autre. Comment garder le même visage sur une image IA lorsqu’on modifie l’environnement ou les vêtements ? Le paramètre --cref (Character Reference) a définitivement réglé cette problématique, s’imposant comme le standard industriel.

Contrairement à un simple upload d’image qui viendrait parasiter toute la composition, --cref indique à l’algorithme d’isoler spécifiquement l’anatomie du personnage. On ajoute l’URL de l’image source à la fin du prompt, suivie de cette balise. Le modèle verrouille alors les traits du visage, la couleur des yeux et la structure osseuse de la personne. Il est impératif d’y associer le paramètre de poids du personnage : --cw (Character Weight), qui s’échelonne de 0 à 100.

- –cw 100 : Le système reproduit le visage, mais aussi la coupe de cheveux et la tenue vestimentaire exacte. Option idéale pour transposer le sujet dans un nouveau décor urbain sans rien altérer de son apparence.

- –cw 0 : Seul le visage pur est conservé. C’est la configuration requise pour habiller un modèle différemment, le mettre en armure médiévale ou lui changer de coiffure, tout en gardant une cohérence faciale indiscutable.

Pour approfondir les détails techniques de l’encodage facial, consulter la documentation officielle de Midjourney reste une étape incontournable.

La seconde évolution majeure concerne la direction artistique avec le paramètre --sref (Style Reference). Souvent, on possède la photographie d’un sujet parfait, mais on désire lui appliquer l’esthétique d’une peinture à l’huile du 19ème siècle ou le grain spécifique d’un film pellicule Kodak. En insérant --sref URL_DU_STYLE, l’algorithme occulte totalement le contenu de l’image de référence pour n’en extraire que la texture, l’étalonnage colorimétrique et le type d’objectif photographique. Ce poids stylistique s’ajuste finement avec le paramètre --sw (de 0 à 1000).

Formules Multimodales : Mixer Deux Photos par l’Intelligence Artificielle

L’hybridation exige une rigueur syntaxique. Déposer simplement deux liens URL l’un à côté de l’autre produit généralement des résultats chaotiques. Le moteur a besoin d’un liant textuel robuste pour comprendre comment entremêler ces deux fichiers. Ce texte n’est pas une simple description ; c’est un pont mathématique dirigeant l’attention de l’IA.

La Formule de la Texture Appliquée

Cette structure est spécifiquement pensée pour utiliser la géométrie d’une première image tout en lui imposant la matière organique ou inorganique d’une seconde.

[URL_Image_Geometrie_Voiture][URL_Image_Texture_Scarabee] Voiture de sport hybride organique, la carrosserie est entièrement recouverte d'une armure d'insecte verte et noire, reflets métalliques sous une lumière néon industrielle, texture chitineuse ultra détaillée, macro photographie automobile cinématographique --iw 1.5 --ar 16:9Le texte force l’intégration : il indique clairement que le scarabée n’est pas un insecte géant posé à côté du véhicule, mais qu’il constitue le matériau physique composant la carrosserie elle-même.

La Formule du Transfert d’Époque

Ce format permet de modifier radicalement le contexte temporel ou stylistique d’un sujet pris dans une situation quotidienne banale.

[URL_Image_Selfie_Moderne][URL_Image_Peinture_Historique] L'homme du selfie porte un majestueux uniforme militaire naval historique orné de médailles en or, ciel d'orage menaçant en arrière-plan, peinture à l'huile classique, empâtement épais visible sur la toile, style musée des beaux-arts, portrait dramatique --ar 4:5 --v 6.0Le prompt dicte l’action dominante. Il confirme au réseau neuronal que le style de l’image 2 doit totalement cannibaliser l’esthétique de l’image 1 sans en modifier les proportions du visage.

5 Templates de Prompts pour l’Image-to-Image

Afin d’accélérer vos expérimentations et de dépasser l’angoisse de la page blanche, voici cinq modèles de requêtes optimisés. Il suffit de copier le bloc et de remplacer les indications entre crochets par vos propres URL.

1. Le Changement de Décor (Background Swap)

Portrait en pied du sujet marchant dans les rues pluvieuses de Tokyo la nuit, enseignes lumineuses au néon éclairant le visage, reflets intenses sur l'asphalte humide, ambiance cyberpunk légère, objectif 35mm --cref[URL_Personnage] --cw 100 --ar 16:92. Le Transfert de Style (Style Transfer)

Photographie éditoriale du sujet principal, éclairage naturel doux venant d'une fenêtre à gauche, détails photoréalistes sur la peau --sref[URL_Style_Artistique] --sw 800 --v 6.03. Le Rajeunissement ou Vieillissement

Portrait en gros plan du sujet,[plus vieux de 20 ans / version enfant], rides d'expression marquées, cheveux poivre et sel, éclairage de studio dramatique sur fond noir absolu --cref [URL_Visage] --cw 0 --iw 14. Du Croquis au Rendu 3D (Sketch to Render)[URL_Croquis_Architectural] Rendu 3D hyperréaliste de la structure, matériaux en béton brut et bois naturel, grandes baies vitrées reflétant le soleil, lumière dorée de fin d'après-midi, Unreal Engine 5, Octane Render, photographie d'architecture --iw 25. La Fusion Animale Chimérique

[URL_Animal_1] [URL_Animal_2] Créature chimérique majestueuse, photographie animalière digne du National Geographic, hyper détaillé, en pleine course dans la savane africaine, poussière soulevée par les pattes, téléobjectif 200mm, action shot --ar 3:2Midjourney /blend vs Stable Diffusion IP-Adapter

Les professionnels de l’image font systématiquement face à un dilemme d’outillage lorsqu’il s’agit de croiser plusieurs concepts visuels. Les deux leaders du marché adoptent des philosophies radicalement différentes.

D’un côté, la commande /blend intégrée nativement à Midjourney offre une expérience d’une fluidité redoutable. Sans avoir besoin d’écrire le moindre mot, l’utilisateur charge jusqu’à cinq fichiers directement sur Discord, et le système calcule de lui-même la moyenne visuelle optimale. Le rendu esthétique sort presque toujours parfaitement calibré. Le compromis ? L’absence de pilotage directionnel. Si l’algorithme décide d’utiliser l’arrière-plan de l’image A plutôt que la texture de l’image B, modifier cette décision requiert de repasser par des requêtes textuelles lourdes.

De l’autre côté se positionne Stable Diffusion, généralement manipulé via l’interface nodale ComfyUI et les modèles IP-Adapter. Cette méthode s’adresse aux techniciens purs. Elle permet d’intervenir directement dans les couches de « cross-attention » du réseau de neurones. On peut littéralement exiger du modèle : « N’extrais que la posture corporelle de cette première image, prends la palette chromatique précise de la seconde, et applique la profondeur de champ de la troisième ». Cette dissection du prompt demande un apprentissage complexe, mais le niveau de contrôle sur le résultat final justifie largement cet investissement en temps.

Le Raccourci Ultime : L’Outil de Fusion Sémantique

Il existe une troisième voie pour ceux qui refusent de manipuler les schémas complexes d’IP-Adapter, tout en trouvant l’automatisation des commandes de base beaucoup trop restrictive. La solution consiste à confier la traduction des pixels vers la sémantique à un grand modèle de langage spécialisé en vision.

C’est précisément l’objectif d’un Générateur de Prompts Claude Gratuit bien configuré : transformer une intention floue en une requête mathématiquement viable. Mais lorsqu’il s’agit de médias visuels, notre architecture logicielle permet d’aller encore plus loin. Les créateurs peuvent désormais fusionner deux images en un seul prompt IA directement depuis la plateforme. Le système analyse les métadonnées de vos fichiers de référence, en extrait les mots-clés dominants, et rédige la structure syntaxique idéale pour assurer une transition fluide.

L’utilisateur n’a plus qu’à copier cette structure enrichie et à l’injecter dans son moteur de rendu favori. Le temps passé à expérimenter le vocabulaire se réduit drastiquement. L’erreur de syntaxe humaine disparaît. Par ailleurs, si vous rencontrez des difficultés récurrentes sur vos textes actuels, passer par un Audit de Prompts IA met souvent en lumière la raison exacte pour laquelle le modèle ignore une partie spécifique de votre demande.

Foire Aux Questions (FAQ)

Comment garder le même visage sur une image IA avec un nouveau décor ?

La méthode la plus fiable en 2026 consiste à utiliser le paramètre Character Reference (--cref) de Midjourney. Vous uploadez la photo du visage, l’ajoutez à la fin de votre prompt sous la forme --cref URL, et vous y associez le poids de personnage --cw 100 pour conserver la coupe de cheveux et la tenue, ou --cw 0 pour ne verrouiller que l’anatomie faciale.

Pourquoi l’algorithme ignore-t-il l’une de mes deux images sources ?

Ce problème survient généralement lorsque les poids d’image (--iw) sont mal équilibrés ou que la description textuelle est en contradiction totale avec le visuel. Si votre image A montre une forêt dense et que votre texte demande « un désert de sable plat », l’IA donnera priorité au texte, annulant l’influence de l’image. Ajustez le paramètre --iw à 2.0 pour forcer la prise en compte du visuel.

Quelle est la différence entre les paramètres –cref et –sref ?

Le paramètre --cref (Character Reference) s’intéresse uniquement au sujet lui-même (traits du visage, structure). Le paramètre --sref (Style Reference) ignore complètement le sujet pour ne capter que la direction artistique globale (les couleurs, le type de pinceau, le grain photographique ou l’éclairage de la scène).

Comment ajuster la proportion de fusion entre deux photos ?

Dans Midjourney, vous pouvez modifier l’importance relative d’une image en jouant avec sa valeur de poids (--iw) qui va de 0 à 3. Dans Stable Diffusion via ComfyUI, vous devez ajuster les curseurs de poids (weight) directement dans les nœuds IP-Adapter appliqués à chaque image source pour doser finement la fusion.

Peut-on fusionner des images avec des formats différents (portrait et paysage) ?

Oui, l’intelligence artificielle est capable de traiter des formats d’entrée hétérogènes. Cependant, il est fortement recommandé de spécifier le ratio d’aspect final désiré avec le paramètre --ar (ex: --ar 16:9 ou --ar 9:16). Le modèle s’adaptera en générant l’espace manquant ou en recadrant intelligemment l’hybridation.