Vous avez écrit une consigne de trois pages. Vous avez détaillé chaque étape, chaque nuance de ton, chaque interdiction. Pourtant, au moment de générer le résultat, le modèle de langage déraille. Il oublie une contrainte majeure au troisième paragraphe ou invente une donnée qui n’existait pas dans votre texte source.

Ce scénario frustrant n’est pas dû à un manque d’intelligence de la machine. Il provient d’un défaut d’architecture de votre requête. Parler à une IA avancée comme on s’adresse à un être humain est une erreur stratégique monumentale. Les algorithmes ne lisent pas ; ils calculent des probabilités sémantiques. Quand vous mélangez vos instructions, vos données et vos attentes de format dans un seul bloc de texte, vous créez une soupe cognitive que le réseau neuronal peine à digérer.

Les ingénieurs en IA ont résolu ce problème de « fuite d’attention » en utilisant une syntaxe très spécifique. Anthropic a nativement entraîné ses modèles de la série Claude à comprendre et à prioriser le langage de balisage extensible. Maîtriser les balises XML n’est pas une simple astuce de formatage. C’est l’unique moyen de garantir un résultat zéro défaut, reproductible à grande échelle.

Table des matières

- Pourquoi Claude 4.6 Exige une Architecture XML

- L’Anatomie d’un Prompt « Zéro Défaut »

- Isoler les Données : La Fin des Hallucinations

- Le Chain of Thought Imposé avec <thinking>

- Le Multishot Prompting via les Balises <example>

- La Technique du Prefill pour Forcer le Format

- 3 Templates XML Prêts à l’Emploi

- Automatiser la Création de Prompts Structurés

- Foire Aux Questions (FAQ)

Pourquoi Claude 4.6 Exige une Architecture XML

L’architecture de Claude repose sur des principes d’alignement stricts (Constitutional AI). Contrairement à ChatGPT qui tente de deviner de manière conversationnelle ce que vous voulez, Claude cherche des frontières claires. Son mécanisme d’attention, c’est-à-dire la façon dont il alloue sa puissance de calcul à chaque mot de votre prompt, réagit massivement aux balises < >.

Imaginez que vous deviez trier des milliers de documents administratifs éparpillés sur le sol dans le noir. C’est ce que vit un modèle face à un prompt en texte brut de 4000 mots. En utilisant le XML, vous allumez la lumière et rangez chaque document dans un classeur étiqueté. Le modèle n’a plus à évaluer si la phrase « Le client est roi » est une instruction de votre part ou une donnée issue du texte à analyser.

Cette compartimentation est vitale lorsque vous exploitez la fenêtre de contexte massive de Claude (jusqu’à 200 000 tokens). Sans balisage, le modèle souffre du biais de récence : il oublie vos directives initiales pour se concentrer uniquement sur les dernières phrases lues. Le XML force l’algorithme à conserver la hiérarchie de vos ordres tout au long de sa génération.

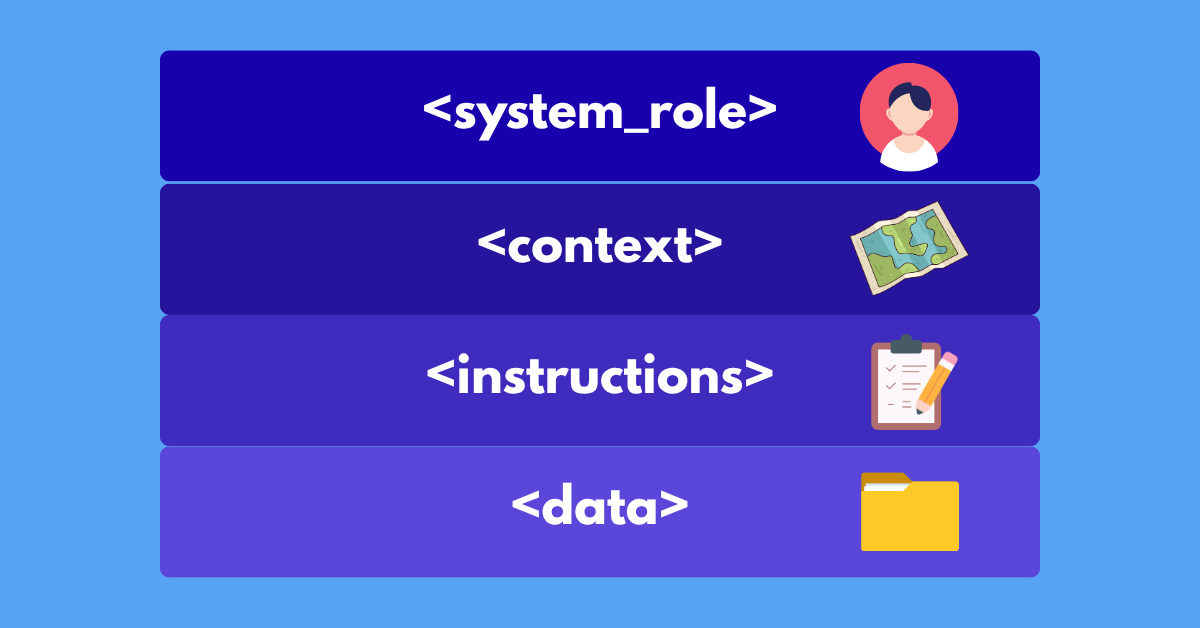

L’Anatomie d’un Prompt « Zéro Défaut »

Un prompt d’ingénierie ne ressemble en rien à une conversation. Il s’apparente à un script de programmation. Il doit contenir un rôle, un contexte, des instructions opératoires, et des garde-fous. Chaque élément possède sa propre balise.

La Balise <system_role> (Le Persona)

C’est l’amorce psychologique. Vous ne demandez pas simplement d’accomplir une tâche ; vous modifiez le réseau de neurones en lui imposant un prisme d’expertise. Tout vocabulaire non pertinent pour ce rôle est immédiatement désactivé dans l’espace latent.

La Balise <context> (L’Environnement)

C’est ici que vous expliquez pourquoi la tâche doit être accomplie. Fournir le contexte empêche l’IA de prendre des décisions génériques. Si elle sait que le texte généré s’adresse à des chirurgiens cardiaques plutôt qu’à des étudiants en première année, la complexité syntaxique s’adaptera d’elle-même.

La Balise <instructions> (Le Cadre Strict)

Cette section remplace les vagues requêtes. Elle doit contenir des verbes d’action impératifs. C’est également là que vous intégrez vos contraintes négatives. Ne dites pas « sois bref ». Dites « Ne dépasse sous aucun prétexte 150 mots ». La machine a besoin d’une limite mathématique, pas d’une suggestion stylistique.

Isoler les Données : La Fin des Hallucinations

L’erreur la plus destructrice en prompt engineering consiste à coller un article ou un code à analyser directement à la suite de sa question. C’est la porte ouverte aux hallucinations (quand l’IA invente des faits) et aux injections de prompt (quand l’IA exécute une instruction cachée dans le texte source).

La règle d’or d’Anthropic est absolue : les données brutes doivent être encapsulées. Toujours.

<instructions>

Analyse le document ci-dessous et extrais uniquement les noms d'entreprises mentionnées. Ne résume pas le texte.

</instructions>

[Votre long texte collé ici]

Cette séparation chirurgicale permet à Claude de comprendre que le contenu de <document_source> est une matière inerte. Il ne doit pas y obéir, il doit seulement l’analyser. C’est particulièrement crucial lorsque vous demandez à l’IA de vérifier des contrats juridiques ou du code contenant des fonctions d’exécution.

Le Chain of Thought Imposé avec <thinking>

Voici le secret le mieux gardé des développeurs utilisant l’API d’Anthropic. Si vous posez un problème complexe à Claude et lui demandez la réponse immédiatement, il échouera une fois sur deux. Les réseaux neuronaux ne peuvent pas « réfléchir en silence ». Leur réflexion est le texte qu’ils génèrent. Plus ils écrivent, plus ils décomposent la logique du problème.

Pour forcer cette analyse sans polluer votre résultat final, vous devez imposer l’utilisation d’une balise de brouillon cognitif. Vous lui ordonnez de réfléchir à voix haute avant de formuler sa réponse officielle.

<instructions>

Avant de fournir la réponse finale, utilise la balise <thinking> pour :

1. Décomposer le problème en trois étapes logiques.

2. Vérifier si ta première intuition contredit les règles établies.

3. Formuler un brouillon de solution.

Une fois cette réflexion terminée, fournis ta réponse définitive à l'intérieur de la balise .

Ce simple ajout réduit le taux d’erreur de logique de plus de 80%. Le modèle repère ses propres contradictions mathématiques ou factuelles pendant la phase de « thinking » et corrige sa trajectoire avant de fermer la balise. Le résultat final, isolé dans <final_answer>, est d’une fiabilité clinique.

Le Multishot Prompting via les Balises <example>

Même le meilleur prompt descriptif atteint ses limites face à des exigences de formatage complexes. Vous avez beau expliquer ce qu’est un « ton professionnel mais impertinent », l’IA interprétera toujours ces mots à travers le prisme de ses données d’entraînement globales.

Le Multishot Prompting court-circuite ce problème. Au lieu d’expliquer ce que vous voulez, vous le démontrez. En fournissant plusieurs exemples d’entrées et de sorties parfaitement exécutées, vous calibrez l’algorithme sur vos propres standards. Il opère alors une reconnaissance de motif (pattern recognition) foudroyante.

<examples>

<example>

<input>Le produit X est super bien pour couper des trucs.</input>

<output_attendu>La lame de précision en acier carbone du modèle X offre une découpe chirurgicale des matériaux denses.</output_attendu>

</example>

Il pleut souvent avec ce manteau.

La membrane Gore-Tex de cette parka garantit une imperméabilité absolue face aux pluies torrentielles.

L’utilisation de trois à cinq exemples est généralement suffisante. Ce balisage strict empêche l’IA de devier de la structure que vous lui avez enseignée.

La Technique du Prefill pour Forcer le Format

Les intelligences artificielles ont été conçues pour être polies. C’est un fléau pour l’automatisation. Lorsque vous exigez qu’un modèle vous renvoie uniquement du code JSON, il est très fréquent qu’il génère : « Bien sûr, voici le code JSON que vous m’avez demandé : « `json {…} « ` ». Ce texte d’introduction casse les intégrations logicielles.

La technique du « Prefill » (pré-remplissage) contourne cette courtoisie forcée. Dans l’API d’Anthropic ou via certains générateurs avancés, vous avez la possibilité de dicter les premiers mots de la réponse de l’assistant.

En injectant simplement { comme premier caractère de la réponse de l’assistant, vous contraignez mathématiquement le modèle à poursuivre cette structure de données. Il n’a littéralement pas la possibilité technique de générer une phrase d’introduction, car l’accolade d’ouverture a déjà engagé le format JSON. C’est la méthode absolue pour obtenir un résultat directement exploitable, sans nettoyage manuel ultérieur.

3 Templates XML Prêts à l’Emploi

La théorie est posée. Passons à l’exécution. Voici trois structures éprouvées que vous pouvez copier-coller dans Claude 4.6. Remplacez simplement le texte entre crochets par vos propres données.

Template 1 : Extraction de Données Massives

<system_role>Tu es un analyste de données impitoyable. Ta seule fonction est l'extraction factuelle pure.</system_role>

Lis attentivement le contenu de la balise .

Extrais toutes les dates mentionnées et l'événement associé.

Si une date est imprécise (ex: "l'année dernière"), ignore-la totalement.

N'ajoute aucune introduction ni conclusion à ta réponse.

Formatte ta réponse exclusivement avec la balise contenant des sous-balises Description succincte .

[Insérez votre rapport ou article ici]

Template 2 : Rédaction SEO Sous Contraintes

Si votre objectif est de maintenir un trafic organique puissant tout en évitant les filtres algorithmiques des moteurs de recherche, la structure de la requête est primordiale. Les techniques pour humaniser un texte IA s’appuient fondamentalement sur ce type de balisage limitatif.

<context>

Nous rédigeons un article de blog B2B ciblant le mot-clé principal : "[VOTRE MOT-CLÉ]".

L'audience est constituée d'experts qui détestent le jargon marketing creux.

</context>

Rédige une section de 300 mots exactement.

Règles absolues :

Interdiction d'utiliser les mots : "révolutionnaire", "innovant", "dans le monde d'aujourd'hui", "en conclusion".

Fais varier drastiquement la longueur des phrases (Burstiness élevé).

Intègre le mot-clé principal une seule fois, de manière organique.

Utilise uniquement les faits suivants pour nourrir le texte :[Insérez vos 3 ou 4 arguments concrets ici]

Template 3 : Analyse Logique et Correction

<instructions>

Examine le texte soumis dans <draft>.

Ta mission est d'identifier les contradictions logiques ou les affirmations non prouvées.

Processus de réflexion obligatoire :

Analyse phrase par phrase.

Pour chaque affirmation forte, cherche si la preuve est fournie dans le texte.

Si la logique est brisée, note l'erreur.

Fournis une liste numérotée des erreurs fatales identifiées, avec une proposition de réécriture concise pour chacune d'entre elles.

[Collez votre brouillon ici]

Automatiser la Création de Prompts Structurés

La rédaction de ces blocs XML demande de la rigueur. L’oubli d’un slash de fermeture </balise> peut suffire à désorienter l’attention du modèle. Dans un flux de travail quotidien, coder ses propres prompts devient rapidement fastidieux. Vous êtes là pour générer de la valeur, pas pour vérifier de la syntaxe.

L’idéal est de s’appuyer sur des outils qui traduisent instantanément vos intentions brutes en architecture XML validée par Anthropic. En utilisant un générateur de prompts Claude gratuit, vous décrivez votre besoin en langage naturel (« Je veux un tableau comparatif de ces deux produits sans introduction »). Le système génère automatiquement les balises <system>, encapsule vos règles, et applique la mécanique de « thinking » appropriée. C’est l’assurance d’un déploiement rapide et sans faille.

Si vous avez déjà rédigé une bibliothèque de consignes par le passé et que vous doutez de leur efficacité sur les nouveaux modèles, il est vital de les soumettre à un audit technique. Prendre le temps de vérifier l’architecture de votre prompt mettra en lumière les conflits sémantiques invisibles qui causaient jusqu’ici des hallucinations partielles.

Foire Aux Questions (FAQ)

Dois-je utiliser de vraies balises HTML ou des mots inventés ?

Le nom exact de la balise importe peu à l’algorithme, tant que la balise d’ouverture et de fermeture correspondent. Vous pouvez utiliser <contexte_entreprise> ou <regles_strictes>. Cependant, l’utilisation des balises standards recommandées par Anthropic (comme <system>, <instructions>, <example>) garantit une activation optimale des poids du réseau neuronal, car le modèle a été spécifiquement entraîné sur ces conventions.

Le XML consomme-t-il trop de tokens de ma limite de contexte ?

L’impact sur la consommation de tokens est négligeable (quelques dizaines de tokens au maximum pour encadrer un texte massif). Le retour sur investissement est écrasant. Les quelques tokens dépensés pour structurer l’information vous évitent de devoir regénérer la réponse cinq fois à cause d’erreurs de compréhension.

Cette technique fonctionne-t-elle avec ChatGPT (OpenAI) ?

Les modèles GPT-4o sont principalement entraînés pour interpréter la syntaxe Markdown (utilisation de # pour les titres, tirets pour les listes). Bien qu’ils comprennent globalement le XML, ils y réagissent avec moins de précision chirurgicale que la série Claude (Sonnet 3.5 / Opus 4.6). Il est toujours préférable d’adapter son balisage au modèle utilisé.

Puis-je imbriquer des balises les unes dans les autres ?

Absolument. C’est même la méthode recommandée pour les structures de données complexes. Vous pouvez avoir une balise principale <documents> qui contient plusieurs sous-balises <doc id="1">, <doc id="2">. Cette imbrication logique permet à Claude de faire des références croisées parfaites (ex: « Compare le doc 1 et le doc 2 »).

Pourquoi l’IA affiche-t-elle ses balises <thinking> dans la réponse finale ?

Si vous utilisez l’interface web classique de Claude, le contenu de la balise de réflexion sera visible. Ce n’est pas un bug, c’est la preuve que l’algorithme « brouillonne ». Si vous utilisez l’API pour automatiser un processus, il vous suffit de programmer votre code pour qu’il ignore ou masque tout le texte généré entre <thinking> et </thinking>, pour ne garder que la réponse brute.