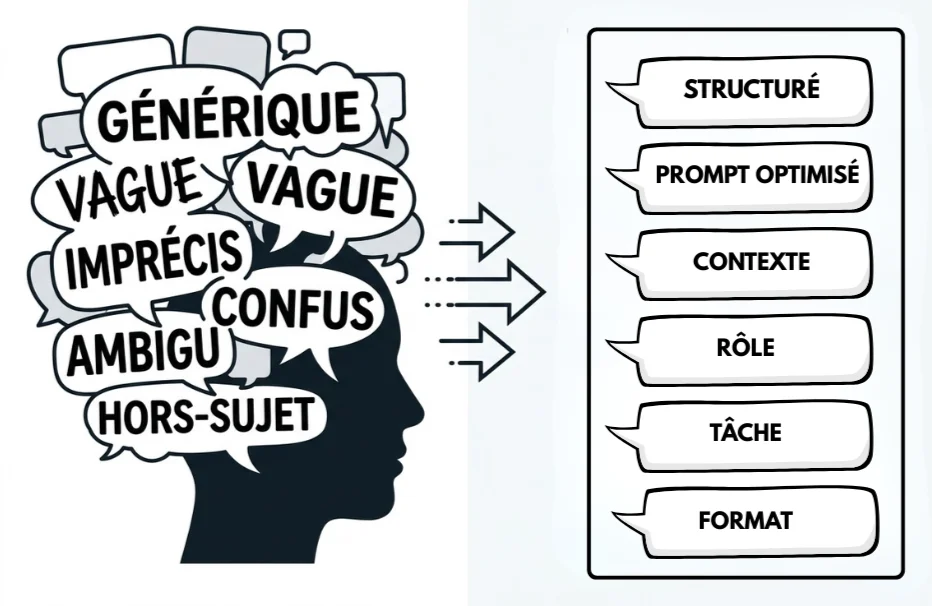

Vous ouvrez l’interface de votre assistant textuel favori. Vous rédigez une instruction que vous pensez parfaitement limpide. Et pourtant, la machine vous retourne un contenu générique, souvent hors-sujet.

Le réflexe naturel consiste à reformuler vaguement sa demande. On ajoute quelques adjectifs. On espère que l’algorithme finira par deviner l’intention cachée. C’est une perte de temps considérable qui draine rapidement vos quotas de génération.

En réalité, le problème provient rarement du modèle de langage. Les architectures actuelles disposent d’une capacité d’analyse exceptionnelle, pour peu qu’on leur parle correctement. L’erreur se situe au niveau de la syntaxe. L’ingénierie textuelle demande une démarche structurée, semblable au code informatique. Un prompt défectueux produira invariablement un résultat médiocre, d’où l’importance de maîtriser l’audit de ses requêtes.

Table des matières

- Pourquoi mon Prompt IA ne Marche Pas : Le Diagnostic

- Le Pouvoir du « Few-Shot Prompting » (Donner des Exemples)

- Les Prompts Négatifs : Ce qu’il ne Faut Pas Faire

- Hallucinations et Perte de Mémoire : Comprendre la Mécanique

- Analyser la Structure d’un Prompt : La Grille d’Audit Manuelle

- Formules de Débogage : Avant / Après

- Quel est le Meilleur Vérificateur de Prompts IA ? (La Voie Rapide)

- Comment Optimiser une Requête : L’Utilisation des Variables

- Foire Aux Questions sur les Prompts IA (FAQ)

Pourquoi mon Prompt IA ne Marche Pas : Le Diagnostic

L’échec d’une génération analytique s’explique rarement par un seul mot mal placé. Il s’agit généralement d’un effondrement structurel. L’analyse des requêtes défectueuses révèle systématiquement trois coupables majeurs qui désorientent le modèle.

Le premier est la surcharge cognitive. Vous demandez à l’IA d’analyser un texte de loi, de le résumer, de le traduire en espagnol, d’adopter un ton humoristique et d’insérer des emojis. Le poids sémantique s’éparpille. L’algorithme se concentre sur les contraintes de forme les plus simples et rate totalement l’analyse juridique profonde.

Le second responsable est le paradoxe de la contrainte. C’est un piège vicieux. Vous donnez deux directives qui s’annulent mathématiquement, comme exiger une « explication très détaillée » tout en imposant « moins de 50 mots ». La machine doit faire un choix arbitraire entre la profondeur et la concision. Le résultat est souvent illisible.

Enfin, l’absence de paramètres de sortie force l’algorithme à deviner vos attentes. Si vous demandez un « plan marketing », l’IA ignore si vous souhaitez un tableau de données, une liste à puces ou un essai académique. Cette ambiguïté consomme une immense quantité de puissance de calcul (« tokens ») uniquement pour évaluer les probabilités de format, laissant moins d’intelligence disponible pour traiter le fond du sujet.

Le Pouvoir du « Few-Shot Prompting » (Donner des Exemples)

Lorsque vous exigez un formatage très spécifique, expliquer les règles avec des mots ne suffit pas toujours. L’IA a besoin d’un modèle visuel. C’est ici qu’intervient le « Few-Shot Prompting », une technique standard documentée dans la documentation officielle d’OpenAI.

La méthode consiste à fournir à la machine un ou deux exemples parfaits de ce que vous attendez directement à l’intérieur de la consigne. Si vous voulez extraire des adresses d’un texte brouillon pour les formater en JSON, ne vous contentez pas de décrire les clés du JSON. Écrivez un exemple concret. Le modèle imitera instantanément la structure.

Cette approche réduit drastiquement le taux d’erreur. Elle agit comme un calque logique. L’algorithme n’a plus besoin d’interpréter vos instructions de formatage : il lui suffit d’appliquer le motif (« pattern ») que vous venez de lui démontrer. C’est particulièrement efficace pour les tâches de classification ou de sentiment.

Les Prompts Négatifs : Ce qu’il ne Faut Pas Faire

Les utilisateurs débutants tentent souvent de guider l’IA en lui indiquant ce qu’elle doit éviter. Ils écrivent « Ne sois pas ennuyeux » ou « N’utilise pas un ton robotique ». C’est une erreur fondamentale liée au fonctionnement des mécanismes d’attention dans les transformeurs.

Lorsque le modèle lit le mot « robotique », ce concept est immédiatement activé dans son espace latent sémantique, même s’il est précédé d’une négation. Ironiquement, interdire un ton spécifique a souvent pour effet d’en rapprocher la réponse générée. L’IA se focalise sur le vocabulaire que vous venez d’introduire.

La solution consiste à utiliser des contraintes positives exclusives. Au lieu de dire « Ne fais pas de longues phrases complexes », écrivez « Utilise uniquement des phrases courtes de moins de 15 mots ». Définissez clairement le périmètre d’action autorisé plutôt que de lister les interdictions.

Hallucinations et Perte de Mémoire : Comprendre la Mécanique

Il est fréquent de voir une IA oublier des consignes données au tout début d’un long texte. Pour comprendre ce phénomène, il faut s’intéresser à la fenêtre de contexte (Context Window). Voyez la mémoire temporaire de l’IA comme un réservoir limité.

Au fur et à mesure que la conversation avance, le réservoir se remplit de « tokens ». L’algorithme souffre naturellement d’un biais de récence. Il accorde statistiquement beaucoup plus d’importance à votre toute dernière phrase qu’à vos instructions initiales. Conséquence immédiate : vos règles de formatage placées au début du prompt sont ignorées lors de la conclusion.

L’astuce d’audit est simple. Répétez toujours vos contraintes absolues à la toute fin de la requête. Le dernier ordre lu doit être le plus important pour garantir une exécution stricte.

Comment réduire les hallucinations de ChatGPT

Les hallucinations se produisent lorsque l’IA invente des faits avec un aplomb indéfectible. L’architecture d’un grand modèle de langage le pousse à deviner le prochain mot le plus probable. S’il n’a pas l’information, il préfère inventer une réponse plausible plutôt que d’avouer son ignorance.

Pour contrer ce comportement, vous devez imposer un ancrage factuel (Grounding). Ajoutez une clause de sortie conditionnelle dans vos prompts sensibles. Par exemple : « Si le document source ne mentionne pas explicitement la date, réponds uniquement : [Information non fournie]. N’extrapole en aucun cas. » Cette instruction casse la boucle probabiliste de l’invention.

Analyser la Structure d’un Prompt : La Grille d’Audit Manuelle

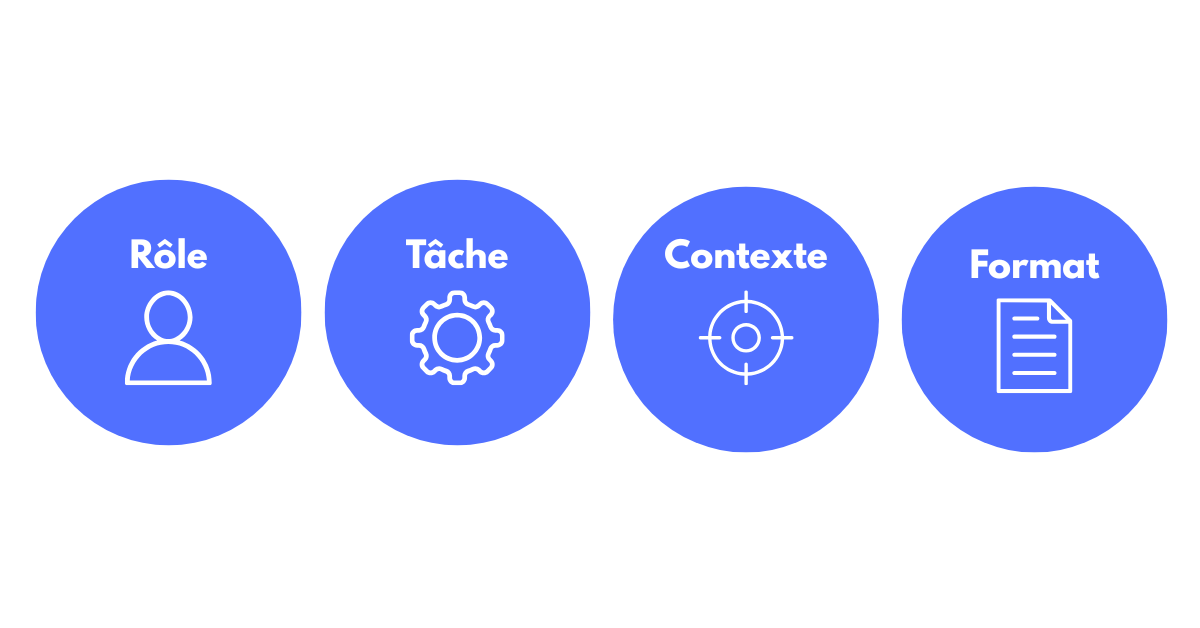

Comment savoir si une requête est solide avant même de l’envoyer ? Les professionnels s’appuient sur une liste de vérification mentale stricte. Passez votre texte au crible de ces quatre piliers pour localiser la faille.

1. Le Rôle (L’Amorceur de Contexte)

Avez-vous défini qui parle ? Sans rôle assigné, l’IA ratisse l’ensemble des données d’internet de manière neutre. En lui imposant un persona, vous filtrez drastiquement son vocabulaire et son niveau d’expertise.

- Mauvais exemple : Écris un article sur la gestion de patrimoine.

- Bon exemple : Agis comme un conseiller financier certifié s’adressant à des jeunes actifs débutants.

2. La Tâche (L’Action Claire)

Votre instruction doit reposer sur un verbe d’action unique et fort. Fuyez les tournures conversationnelles molles. Soyez impératif.

- Mauvais exemple : Parle-moi des différences entre les voitures électriques et thermiques.

- Bon exemple : Compare les coûts d’entretien sur 5 ans entre un véhicule électrique et un modèle thermique équivalent.

3. Le Contexte (Les Limites du Terrain)

Avez-vous précisé le public cible ou l’objectif final du document ? Une explication scientifique sera formulée différemment selon qu’elle s’adresse à un enfant de dix ans ou à un comité de chercheurs universitaires.

- Mauvais exemple : Explique le fonctionnement des trous noirs.

- Bon exemple : Explique le fonctionnement des trous noirs pour des collégiens, en utilisant la métaphore d’un aspirateur cosmique.

4. Le Format (L’Architecture Finale)

Ne laissez jamais l’IA choisir la mise en page. Exigez des tableaux, des listes à puces, ou des balises spécifiques pour isoler les données.

- Mauvais exemple : Fais un résumé des points importants.

- Bon exemple : Synthétise ce texte sous forme de liste à puces (maximum 5 éléments), sans aucune phrase d’introduction ni conclusion.

Si vous travaillez la génération visuelle, le contexte est tout aussi vital. L’extraction précise du vocabulaire initial d’une image de référence change complètement le rendu final de votre génération.

Formules de Débogage : Avant / Après

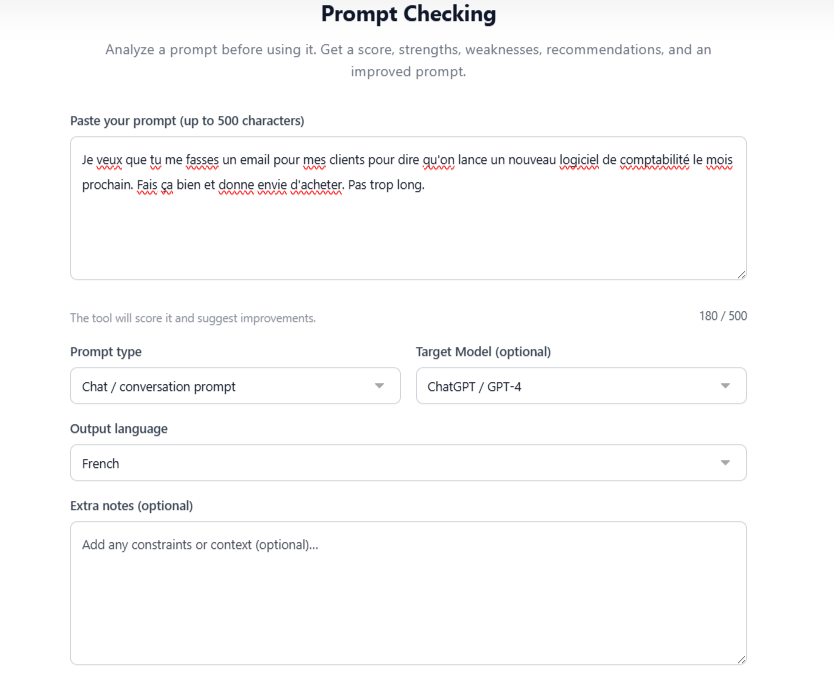

La théorie atteint vite ses limites. L’idéal est de visualiser la différence entre une commande rédigée à la hâte et une requête optimisée. Observez la densification de l’information.

Le prompt désastreux (ce que font la majorité des utilisateurs) laisse d’immenses zones d’ombre que le modèle comblera avec des clichés :

Je veux que tu me fasses un email pour mes clients pour dire qu'on lance un nouveau logiciel de comptabilité le mois prochain. Fais ça bien et donne envie d'acheter. Pas trop long.Le prompt audité et optimisé encadre le modèle de langage de manière hermétique. Les directives de formatage et de tonalité l’empêchent de dévier :

Prends le rôle d'un concepteur-rédacteur spécialisé en e-mail marketing B2B.

Rédige un e-mail de pré-lancement pour annoncer notre nouveau logiciel de comptabilité automatisée nommé "ContaSmart", prévu pour le 15 avril.

La cible : des experts-comptables débordés par la paperasse fiscale. Le ton doit être empathique face à leur charge de travail, factuel, et orienté sur le gain de temps absolu.

Structure la réponse de cette façon : un objet d'e-mail de moins de 6 mots, un corps de texte de maximum 150 mots divisé en trois paragraphes, et un appel à l'action clair proposant de rejoindre une liste d'attente.Certains modèles réagissent extrêmement bien à ce type de structuration rigide en utilisant des balises XML pour séparer encore plus distinctement les instructions des données brutes.

Quel est le Meilleur Vérificateur de Prompts IA ? (La Voie Rapide)

L’audit manuel demande une certaine gymnastique mentale. L’erreur humaine finit toujours par s’infiltrer. Une contrainte oubliée, ou une contradiction créée sans le vouloir, suffit à faire dérailler l’algorithme. L’intention des professionnels s’oriente logiquement vers l’automatisation de ce diagnostic.

Comment fonctionne l’automatisation dans ce domaine ? Un vérificateur utilise un « méta-prompt », c’est-à-dire une IA programmée pour analyser les instructions destinées à une autre IA. Le système dissèque votre requête brute. Il repère les failles logiques, signale les verbes faibles, et vérifie la présence du contexte. Ensuite, il réécrit votre brouillon en intégrant les balises sémantiques nécessaires.

Plutôt que de perdre du temps à corriger vos textes ligne par ligne, utilisez notre Vérificateur de Prompts IA. Cet outil gratuit agit comme un correcteur orthographique, mais dédié à la logique structurelle. Il transforme vos idées floues en commandes de classe mondiale, vous permettant d’économiser vos crédits sur les API payantes.

Comment Optimiser une Requête : L’Utilisation des Variables

Une fois que votre brouillon a été validé par un outil d’analyse et de validation performant, passez au niveau supérieur. Les professionnels n’écrivent jamais un prompt pour un usage unique. Ils créent des modèles réutilisables.

Le secret réside dans l’utilisation de variables. Au lieu d’écrire le nom de votre produit ou de votre cible directement dans la phrase, isolez-les entre crochets. Cette méthode informe le modèle qu’il s’agit d’un champ de données dynamique, séparant ainsi clairement l’instruction (le code) du sujet du jour (la donnée).

Agis comme un expert SEO.

Rédige une balise titre optimisée pour le mot-clé principal :[MOT_CLÉ].

L'audience ciblée est : [AUDIENCE_CIBLE].Même dans un contexte de créativité hybride, comme la génération d’images avec Midjourney ou Stable Diffusion, l’utilisation de variables pour définir précisément les poids d’image et les références stylistiques reste la méthode d’ingénierie la plus fiable.

Foire Aux Questions sur les Prompts IA (FAQ)

Quelle est la longueur idéale d’un prompt IA ?

Il n’existe pas de longueur parfaite en soi. Un bon prompt doit être aussi court que possible, mais aussi long que nécessaire. Si la tâche est simple, trois phrases suffisent. S’il s’agit d’analyser un document complexe, un prompt de 400 mots incluant des exemples et un formatage précis sera requis pour éviter les réponses génériques.

Dois-je utiliser l’anglais ou le français pour de meilleurs résultats ?

Les modèles récents (GPT-4o, Claude 3.5) maîtrisent parfaitement le français. Cependant, la vaste majorité de leurs données d’entraînement techniques reste en anglais. Pour des requêtes de programmation informatique complexes ou des paramètres logiciels très spécifiques, l’anglais produit souvent des résultats légèrement plus précis. Pour la rédaction web, le français direct fonctionne parfaitement.

Comment éviter la surcharge cognitive du modèle de langage ?

Ne demandez jamais à l’IA d’exécuter plus de deux tâches lourdes simultanément. Si vous avez besoin d’une traduction, d’un résumé et d’une analyse de sentiment, divisez le processus. Créez une chaîne de prompts (« Prompt Chaining ») où chaque requête traite une seule étape. Vous obtiendrez des résultats chirurgicaux.

Quelle est la différence entre le Zero-Shot et le Few-Shot Prompting ?

Le Zero-Shot consiste à demander une tâche sans fournir le moindre exemple (ex: « Traduis ce texte »). Le Few-Shot consiste à inclure une ou deux démonstrations du résultat attendu dans le prompt. Le Few-Shot est vivement recommandé par les recommandations d’Anthropic pour fiabiliser le formatage de sortie.

Pourquoi mon prompt fonctionne-t-il sur ChatGPT mais échoue sur Claude ?

Chaque modèle possède sa propre architecture d’alignement. ChatGPT est programmé pour être très conversationnel et tolère bien les instructions vagues. Claude, en revanche, préfère une structure documentaire stricte, utilisant préférentiellement des balises XML pour délimiter le contexte et les données. Il faut adapter la syntaxe à l’outil ciblé.